기존 '하이퍼 커넥션'의 신호 폭증 문제, '이중 확률 행렬' 투영으로 해결 시스템 과부하 막는 '커널 융합' 등 인프라 기술 결합... 27B 모델서 검증

중국의 AI 기업 딥시크(DeepSeek)가 대규모 언어 모델(LLM)의 고질적인 문제인 '학습 불안정성'과 '메모리 병목 현상'을 동시에 해결할 수 있는 새로운 아키텍처 기술 'mHC(Manifold-Constrained Hyper-Connections)'를 공개했다. 이 기술은 AI 모델 내부의 정보 흐름을 수학적으로 정교하게 제어해, 모델의 덩치를 키우면서도 연산 효율성을 극대화한 것이 특징이다.

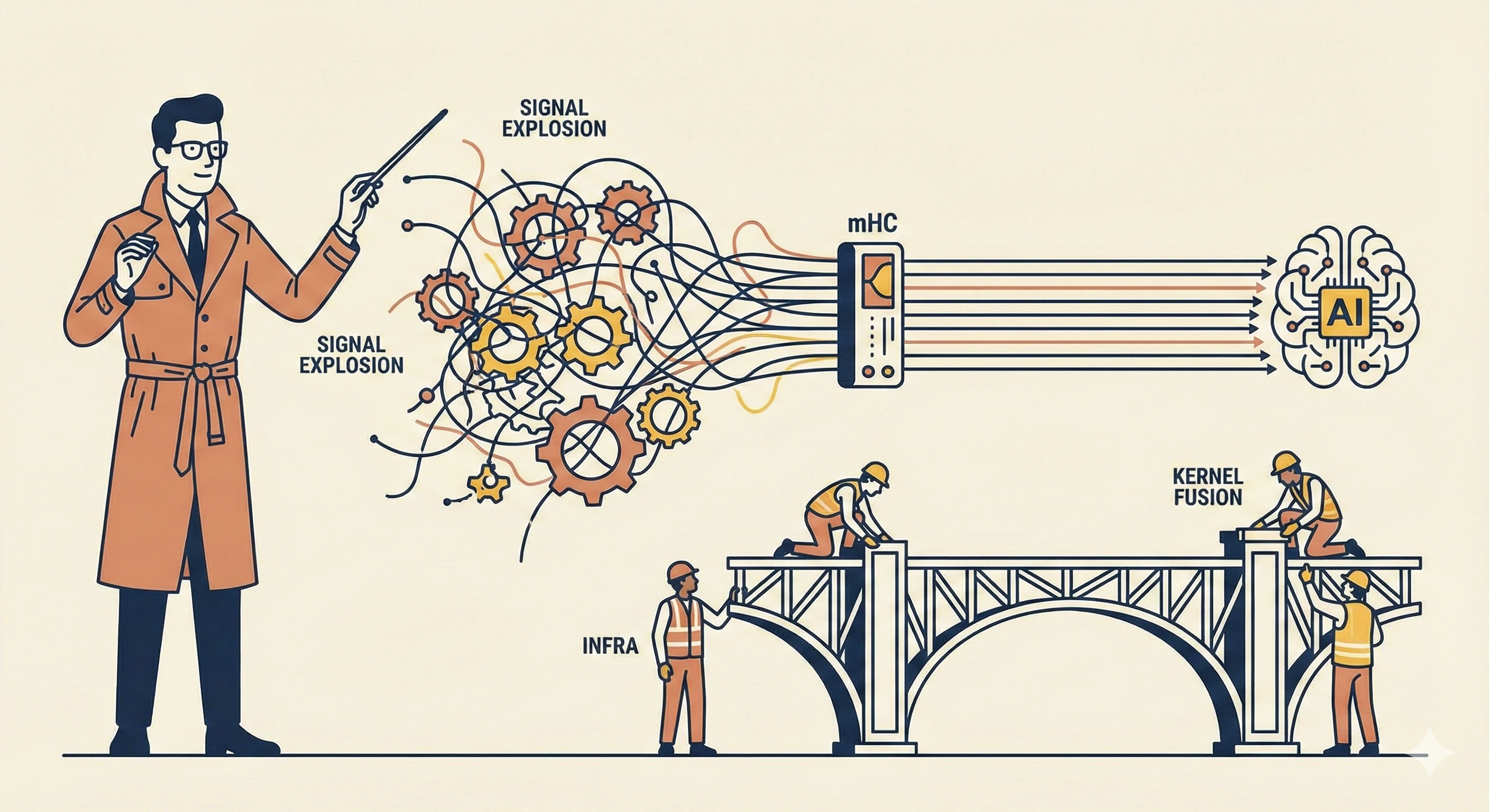

딥시크 연구진이 지난달 31일 발표한 논문에 따르면, 최근 AI 학계에서는 모델의 성능을 높이기 위해 정보 전달 통로를 넓히는 '하이퍼 커넥션(HC)' 방식이 주목받아 왔다. 그러나 이 방식은 층(Layer)이 깊어질수록 신호가 기하급수적으로 증폭(Explosion)되거나 소실되어, 대규모 학습 시 '항등 매핑(Identity Mapping)' 속성이 깨지는 치명적인 한계가 있었다.

이번에 개발된 'mHC'는 이러한 불안정성을 해결하기 위해 '매니폴드 제약(Manifold Constraints)'이라는 새로운 개념을 도입했다. 연구진은 잔차 연결(Residual Connection) 행렬을 '버코프 다면체(Birkhoff polytope)' 공간에 투영하여, 행렬의 행과 열의 합이 항상 1이 되는 '이중 확률 행렬(Doubly Stochastic Matrix)'로 변환했다.

쉽게 말해, 데이터가 이동하는 과정에서 신호의 총량이 제멋대로 커지거나 작아지지 않도록 수학적인 '평형 유지 장치'를 건 셈이다. 이를 통해 mHC는 정보의 교환을 활성화하면서도 신호의 크기를 안정적으로 유지해, 기존 HC 방식에서 최대 3000배까지 치솟던 신호 증폭 현상을 완벽하게 통제하는 데 성공했다.

특히 이번 논문은 단순한 이론 제시에 그치지 않고, 시스템 인프라 차원의 최적화까지 구현했다는 점에서 주목된다. 하이퍼 커넥션 적용 시 데이터 입출력(I/O)이 급증해 발생하는 '메모리 장벽(Memory Wall)' 문제를 해결하기 위해, 연구진은 ▲커널 융합(Kernel Fusion) ▲재연산(Recomputing) ▲통신 중첩(DualPipe) 기술을 적용했다.

그 결과, 딥시크는 270억(27B) 파라미터 모델에서 잔차 스트림(Residual Stream) 폭을 4배(n=4)나 확장했음에도 불구하고, 추가되는 학습 시간 비용을 불과 6.7% 수준으로 억제했다. 이는 고성능 모델을 상용화 가능한 수준의 비용으로 훈련할 수 있음을 입증한 것이다.

실제 성능 지표도 뚜렷한 개선세를 보였다. 27B 모델 테스트 결과, mHC는 복잡한 추론을 요하는 'BBH' 벤치마크와 독해 능력을 평가하는 'DROP' 벤치마크에서 기존 하이퍼 커넥션 모델 대비 각각 2.1%, 2.3% 향상된 점수를 기록했다. 학습 손실률(Loss Gap) 역시 기존 모델보다 빠르게 감소하며 우수한 수렴 속도를 나타냈다.

딥시크 측은 "mHC는 대규모 모델의 위상 구조(Topological Architecture)가 학습 최적화에 미치는 영향을 규명한 연구"라며 "향후 차세대 파운데이션 모델(Foundation Model) 발전의 새로운 방향성을 제시할 것"이라고 전망했다. 이번 연구 성과는 AI 모델의 대형화 추세 속에서 효율성과 안정성이라는 두 마리 토끼를 잡을 핵심 기술이 될 것으로 보인다.

기업 재무 데이터 · 투자 리포트 · 창업 분석을 한 곳에서

Pitchdeck 체험하기매주 엄선된 뉴스, 이메일로 받아보세요

뉴스에포크 뉴스레터 · 무료 · 언제든 해지 가능